DeepSeek-R1 Windows本地部署

DeepSeek-R1 已正式发布,性能对标OpenAI o1正式版,在全球掀起了AI风暴,出于安全等因素,很多同学想在自己的电脑上部署属于自己的deepseek。本文档带大家从零开始在 Windows 11 笔记本上部署deepseek。

一、极简小白版本

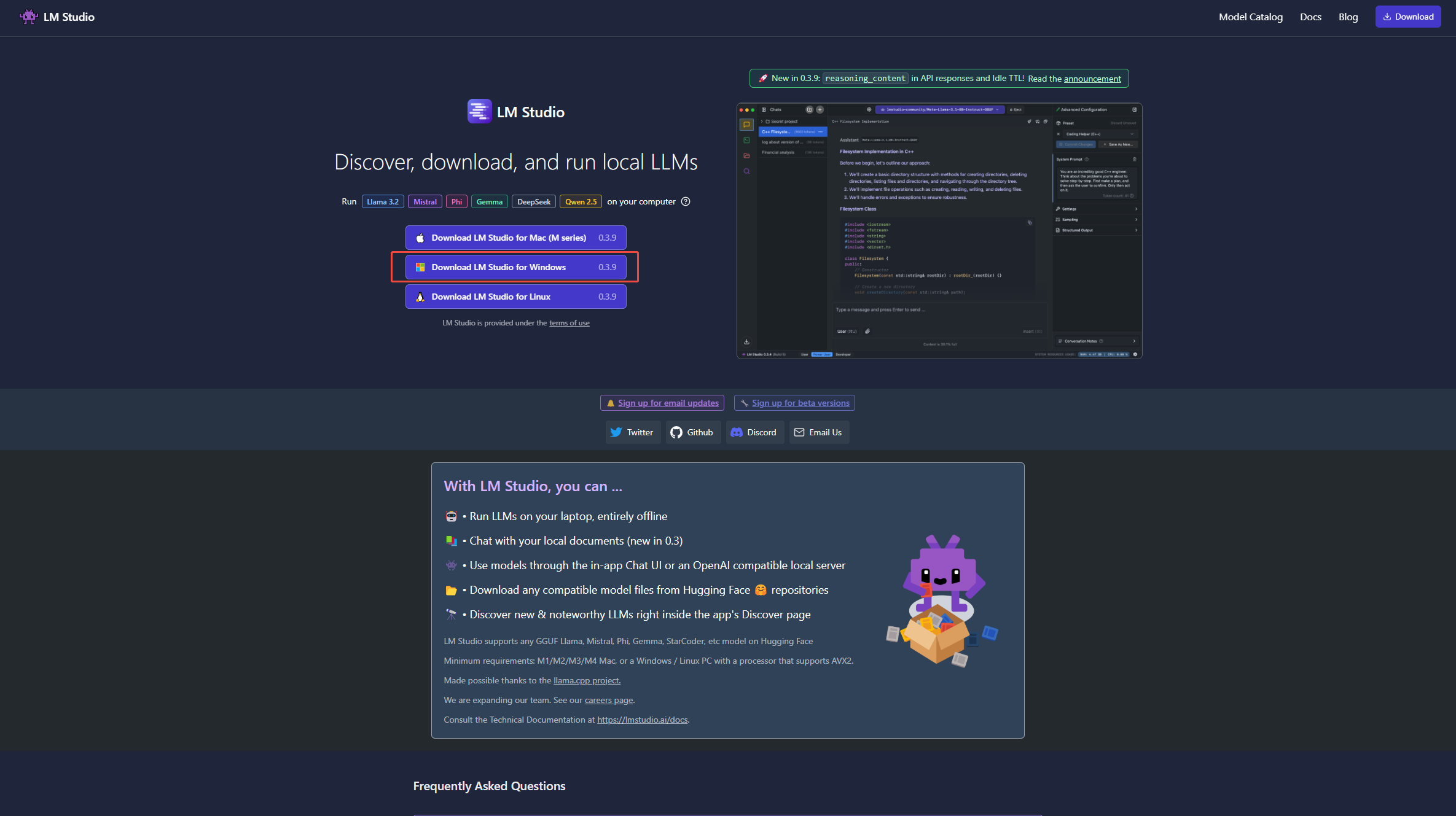

小白可以使用 LM Studio 部署 DeepSeek-R1。

1. 访问 LM Studio官网(https://lmstudio.ai)或者点击此下载链接

2. 选择自己笔记本的版本进行下载安装

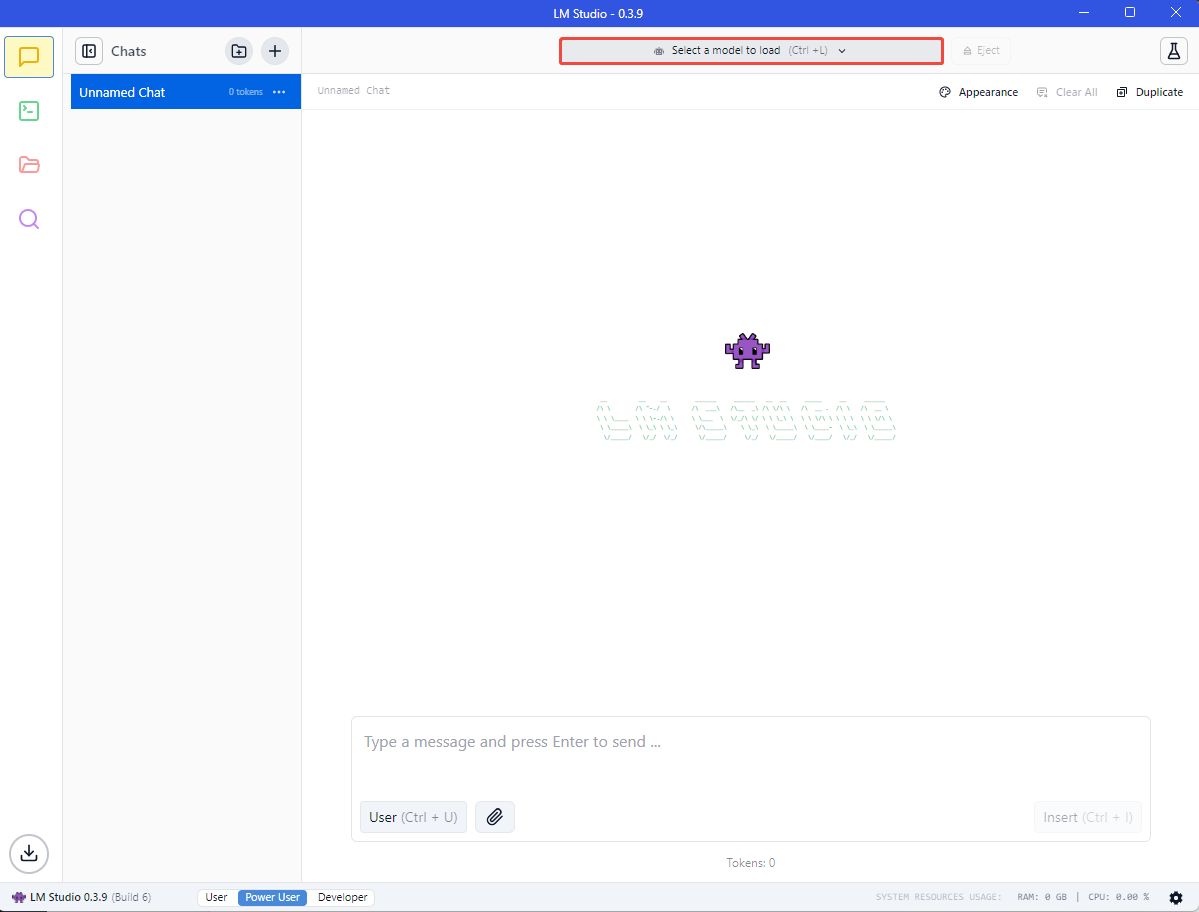

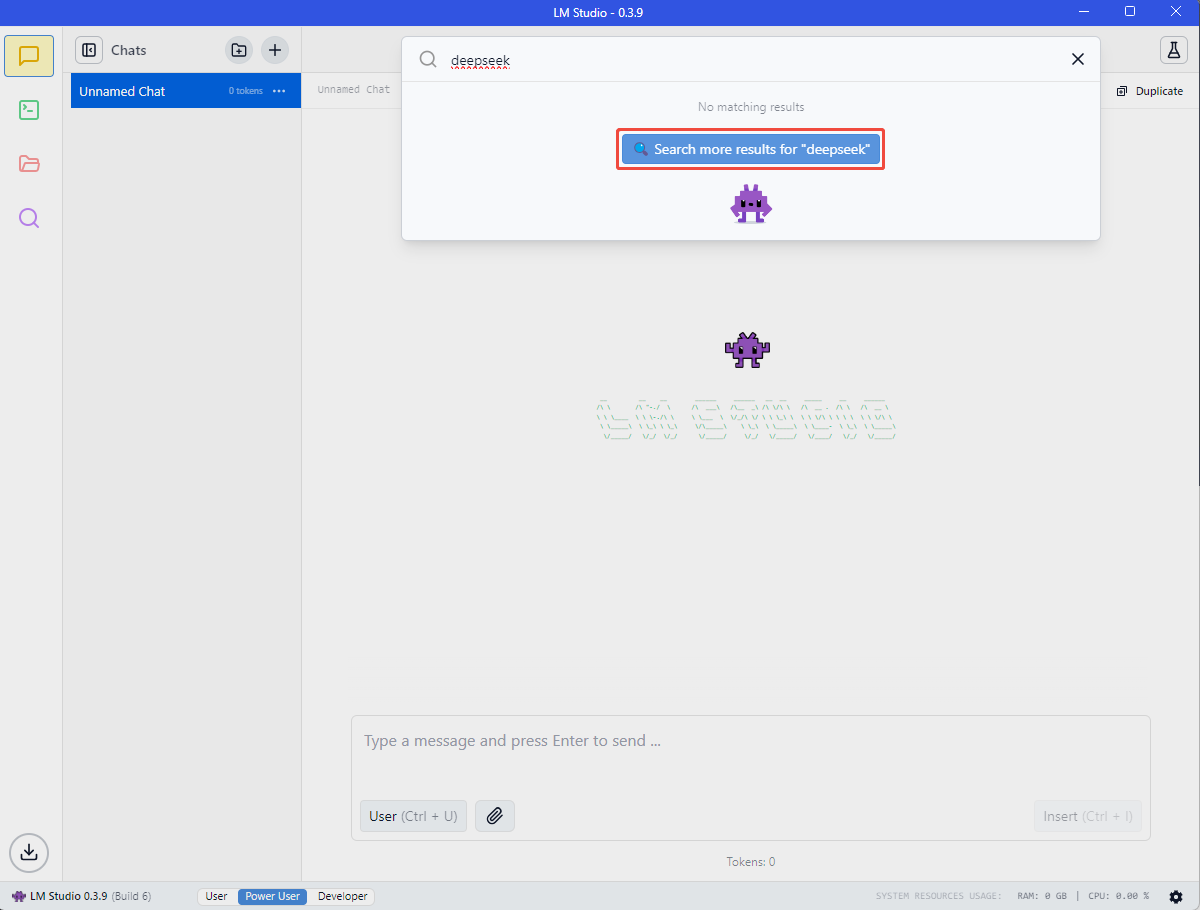

3.点击 select model 并输入 deepseek,并点击 Search more results for “deepseek”

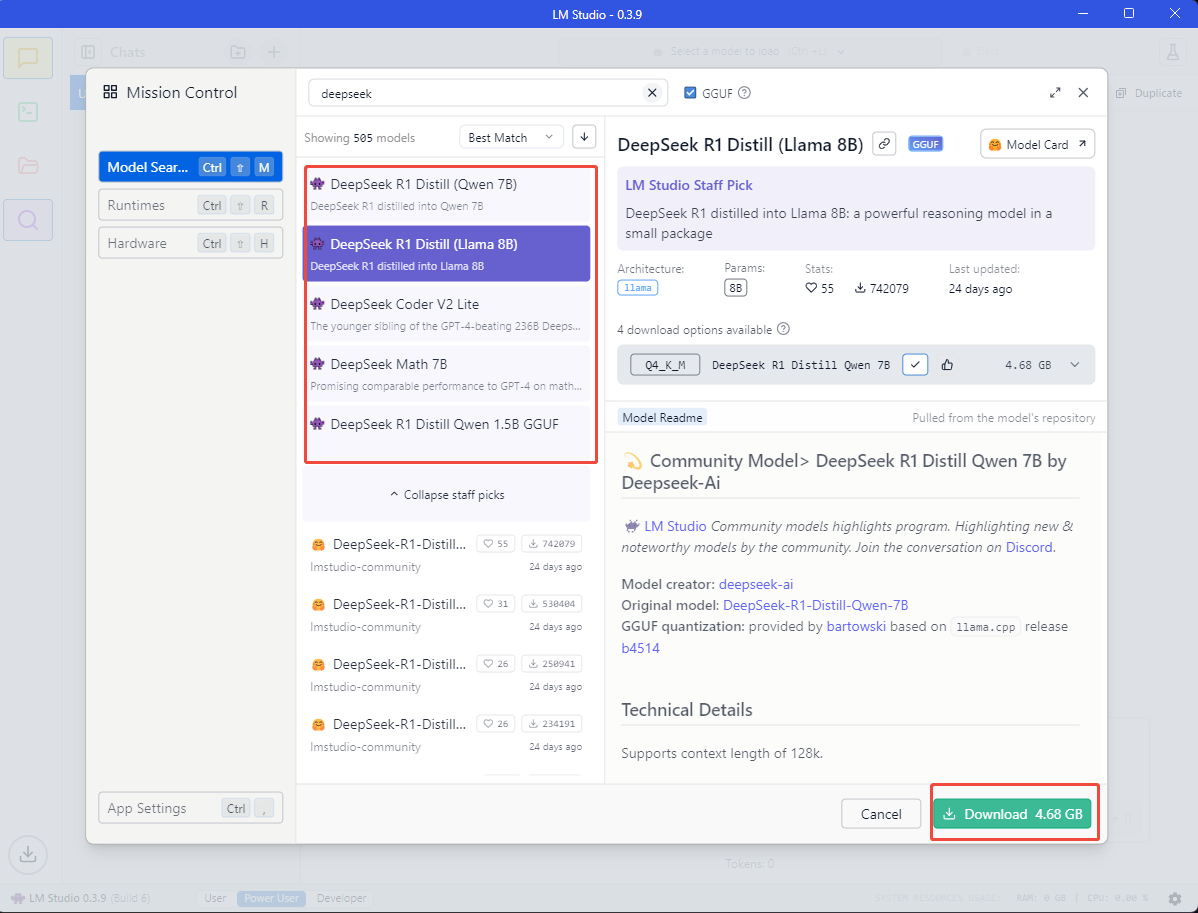

4.选择合适的模型进行下载

提示:如果网络加载错误导致下载失败可尝试以下方式手动加载

4.1 在此地址 https://www.modelscope.cn/models/unsloth/DeepSeek-R1-Distill-Qwen-7B-GGUF/files下载 DeepSeek-R1-Distill-Qwen-7B-GGUF 模型文件夹

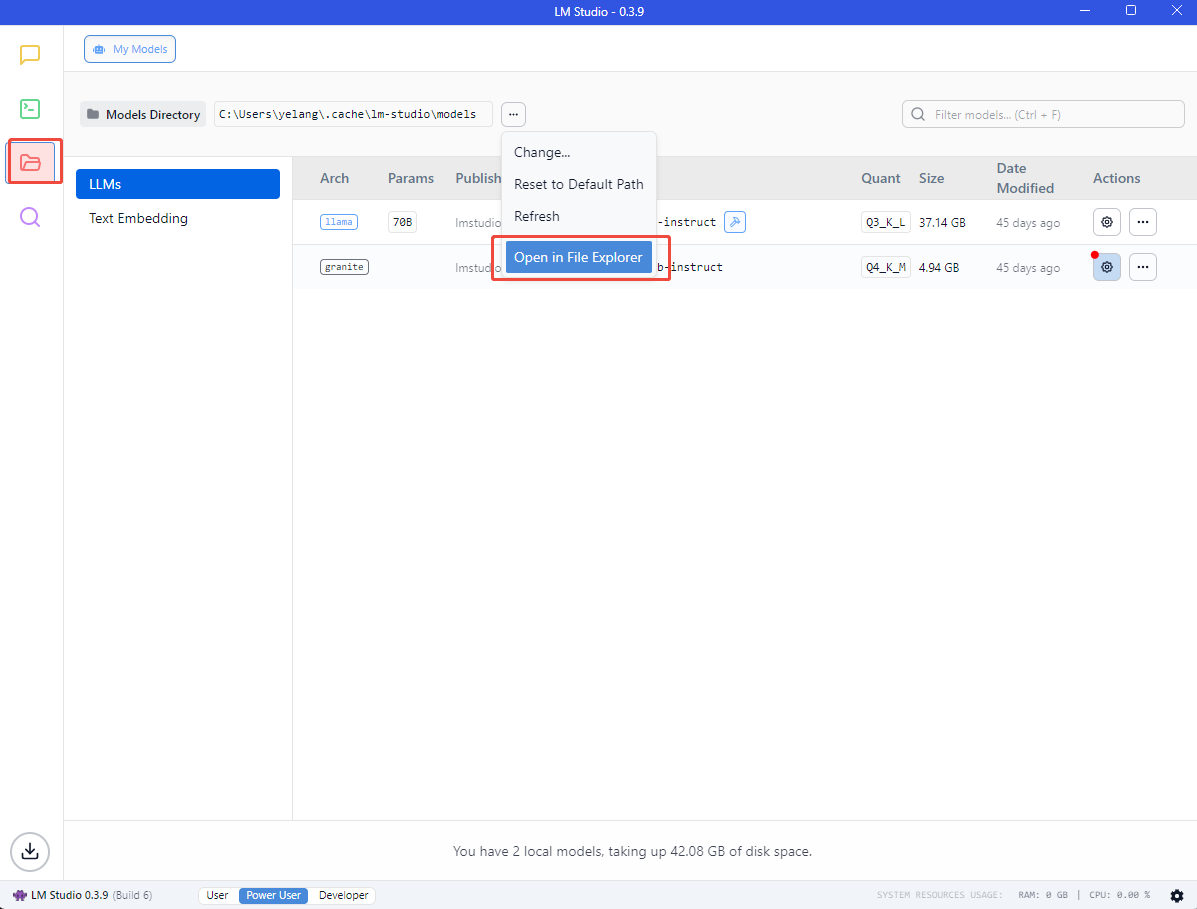

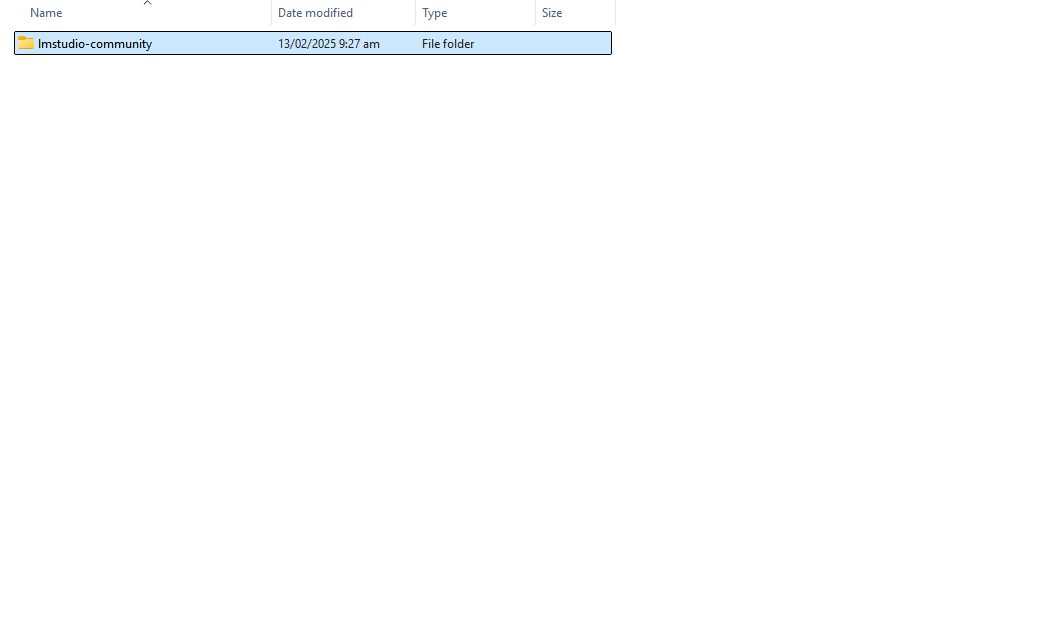

4.2 点击侧边栏 My Models 然后选择 Open in File Explorer, 双击 lmstudio-community 进入模型列表,将4.1下载的 DeepSeek-R1-Distill-Qwen-7B-GGUF 文件夹复制到目录下

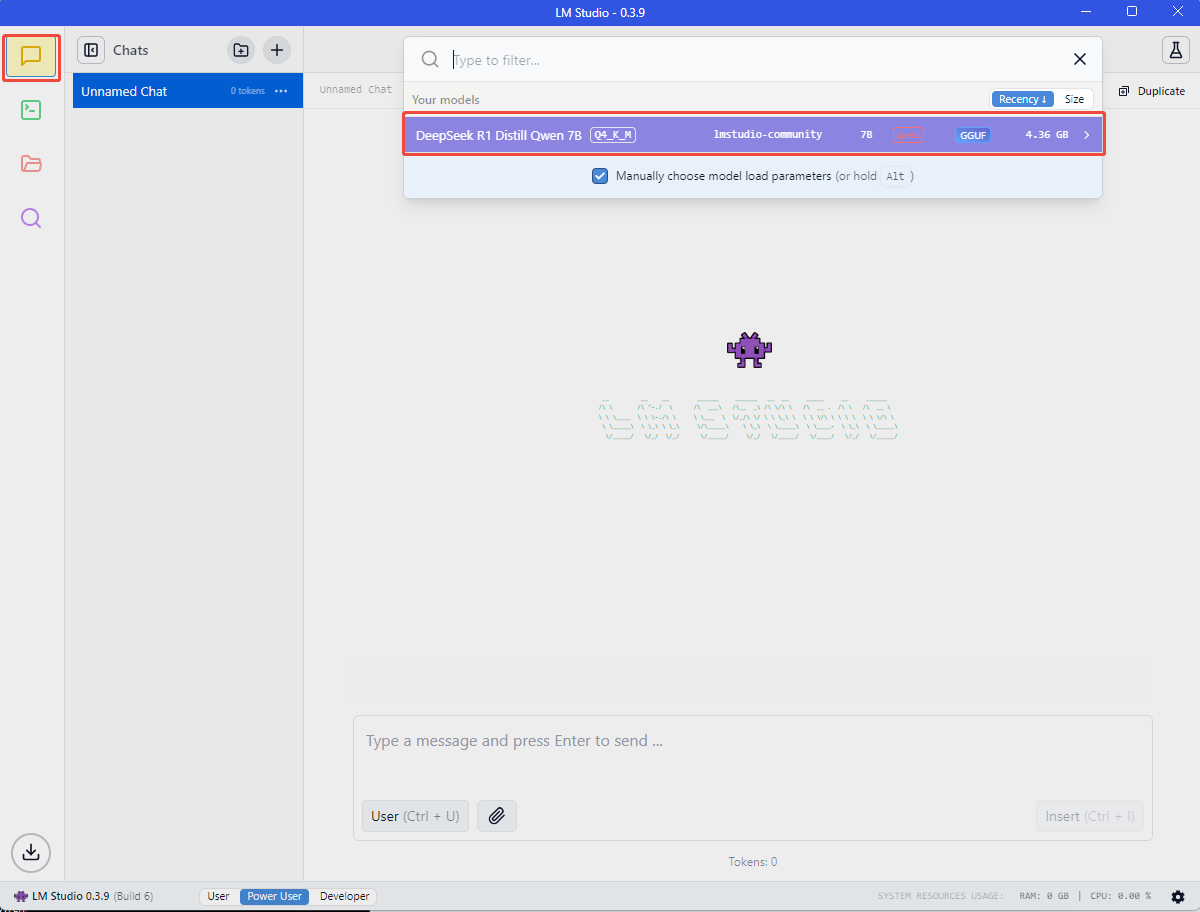

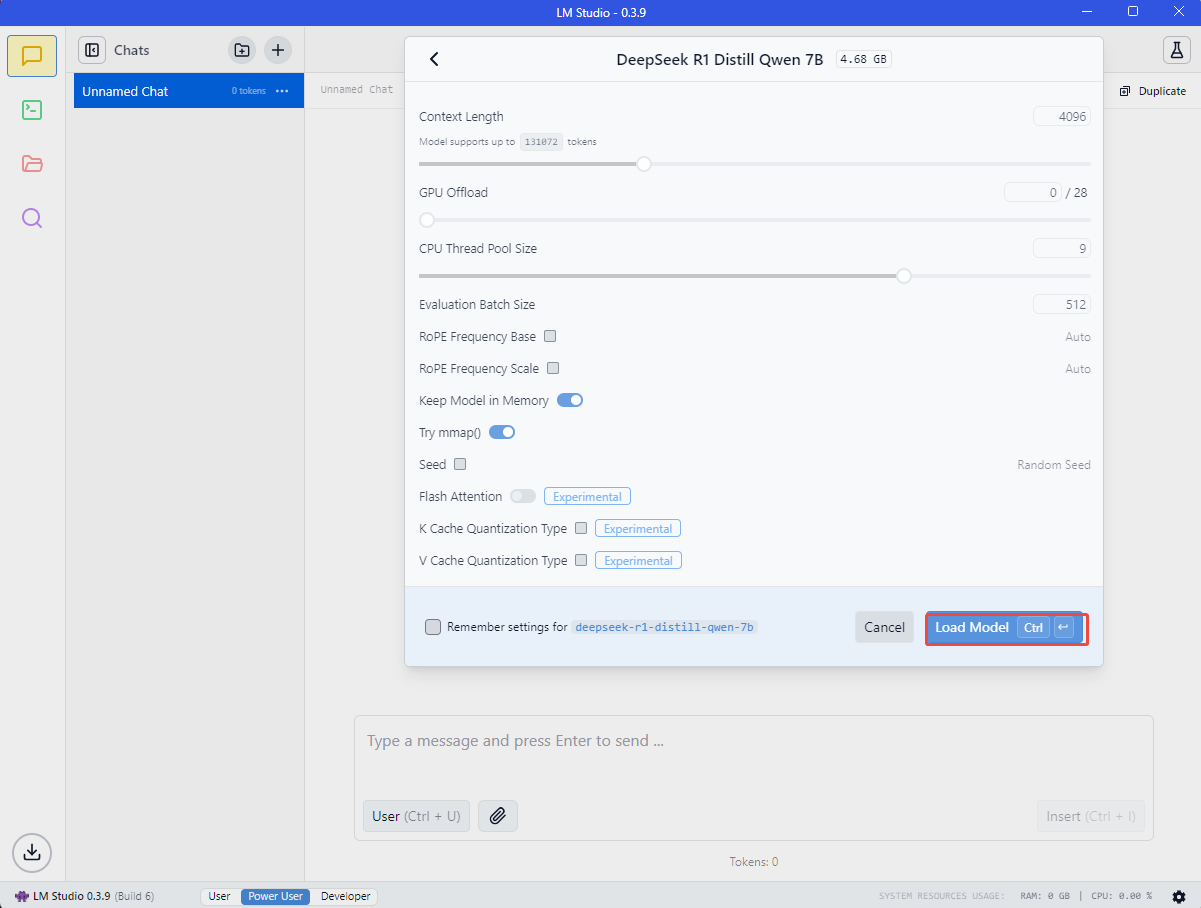

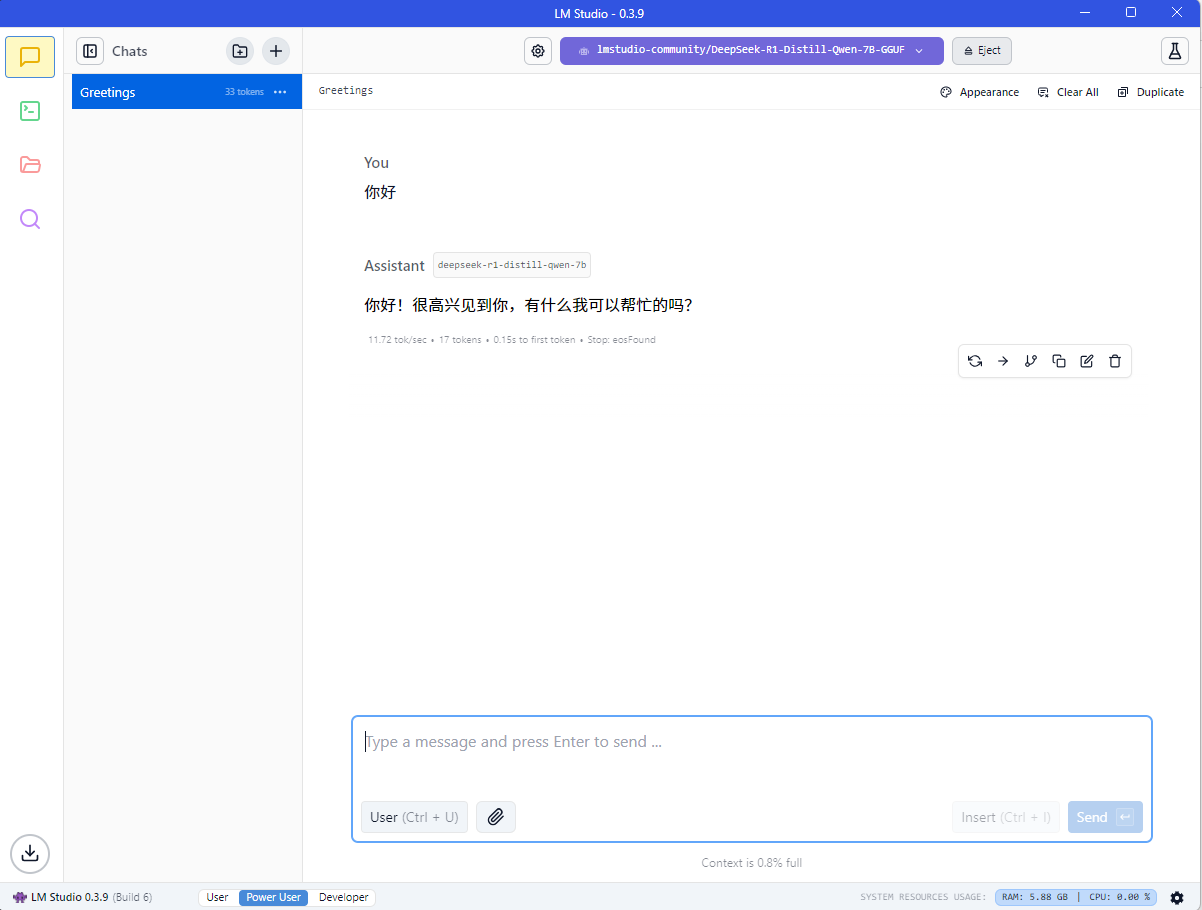

4.3 点击侧边栏的 chat,然后选择 DeepSeek R1 模型,并 Load Model

4.4 到此就拥有属于自己的模型啦

二、进阶版本部署

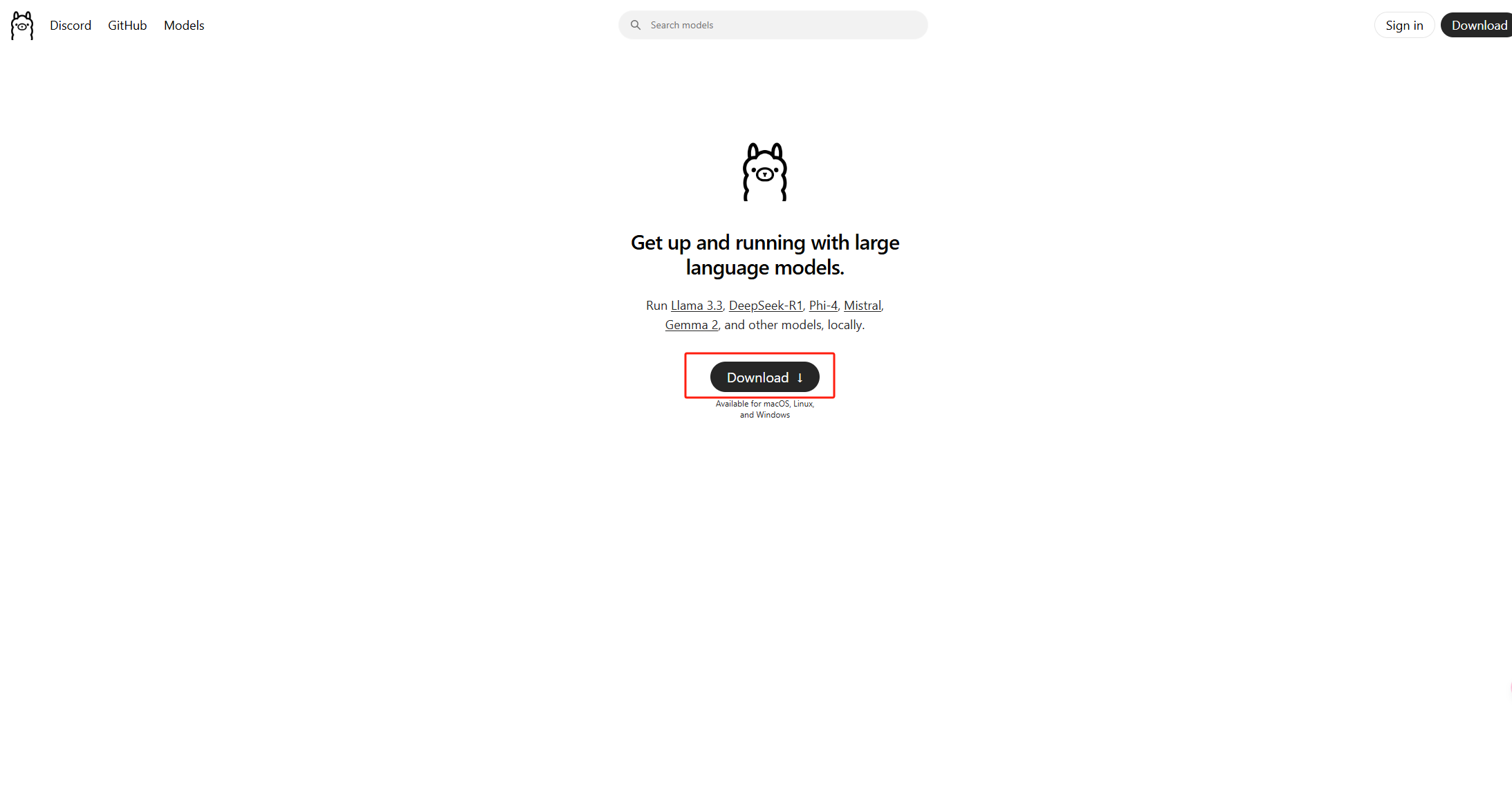

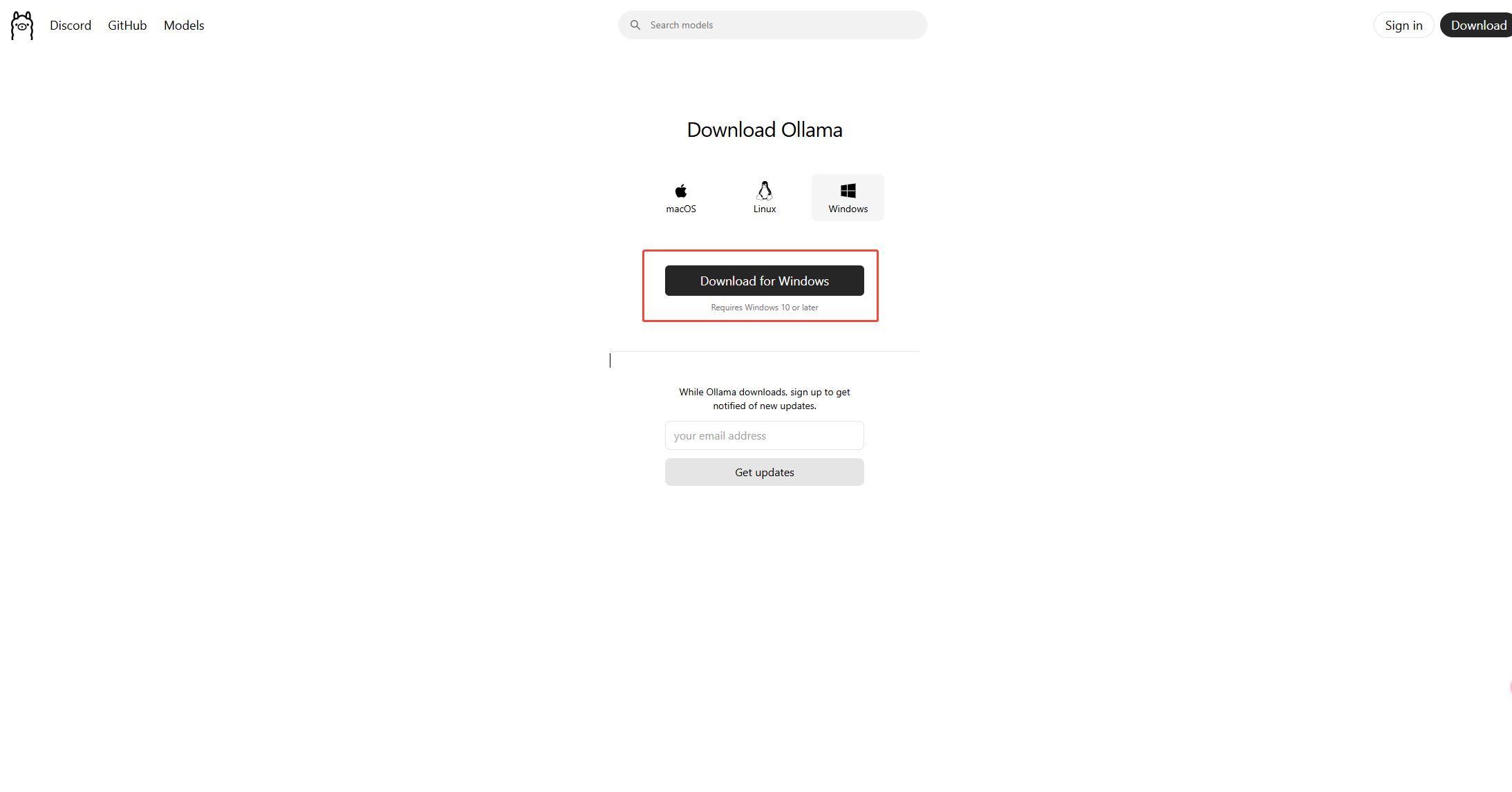

1. 下载 ollama,访问 ollama 官网 https://ollama.com,点击下图所示的 download 按钮,或者访问此下载链接

点击下图所示的 Download for windows 按钮即可开始下载 ollama

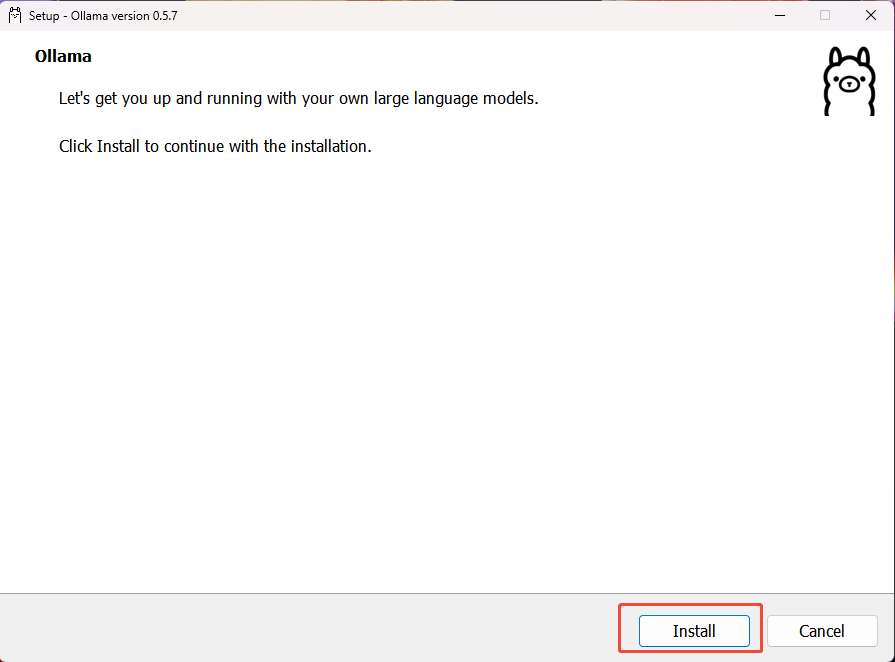

2. 双击下载好的安装包文件,点击下图所示的 Install 即可开始安装。

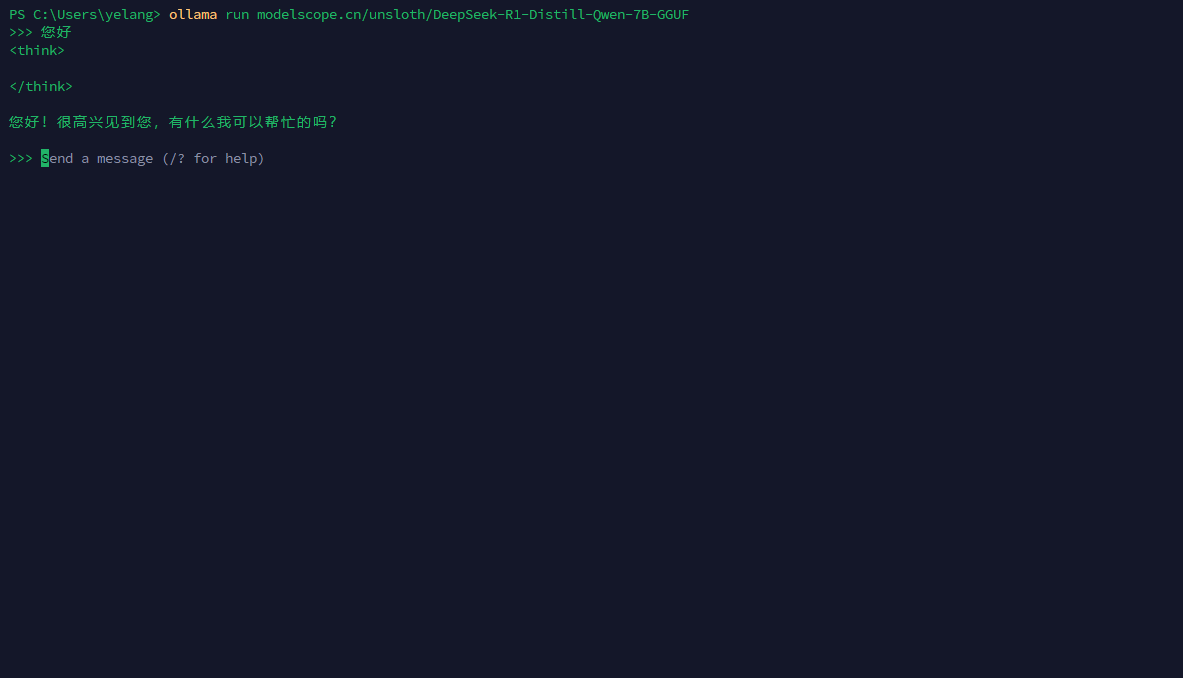

3.开始部署

ollama支持部署多种 DeepSeek-R1 模型,包括常见的基于 Llama 和 Qwen 六个蒸馏的密集模型。如果大家想深入了解最适合自己电脑部署的模型可以联系工作人员进一步了解,本文带着大家部署基于 Qwen 的参数量为7b的模型。

同时按住 windows + R,输入cmd 打开命令行,运行下面的命令

ollama run modelscope.cn/unsloth/DeepSeek-R1-Distill-Qwen-7B-GGUF

等完成后就可以进行对话啦

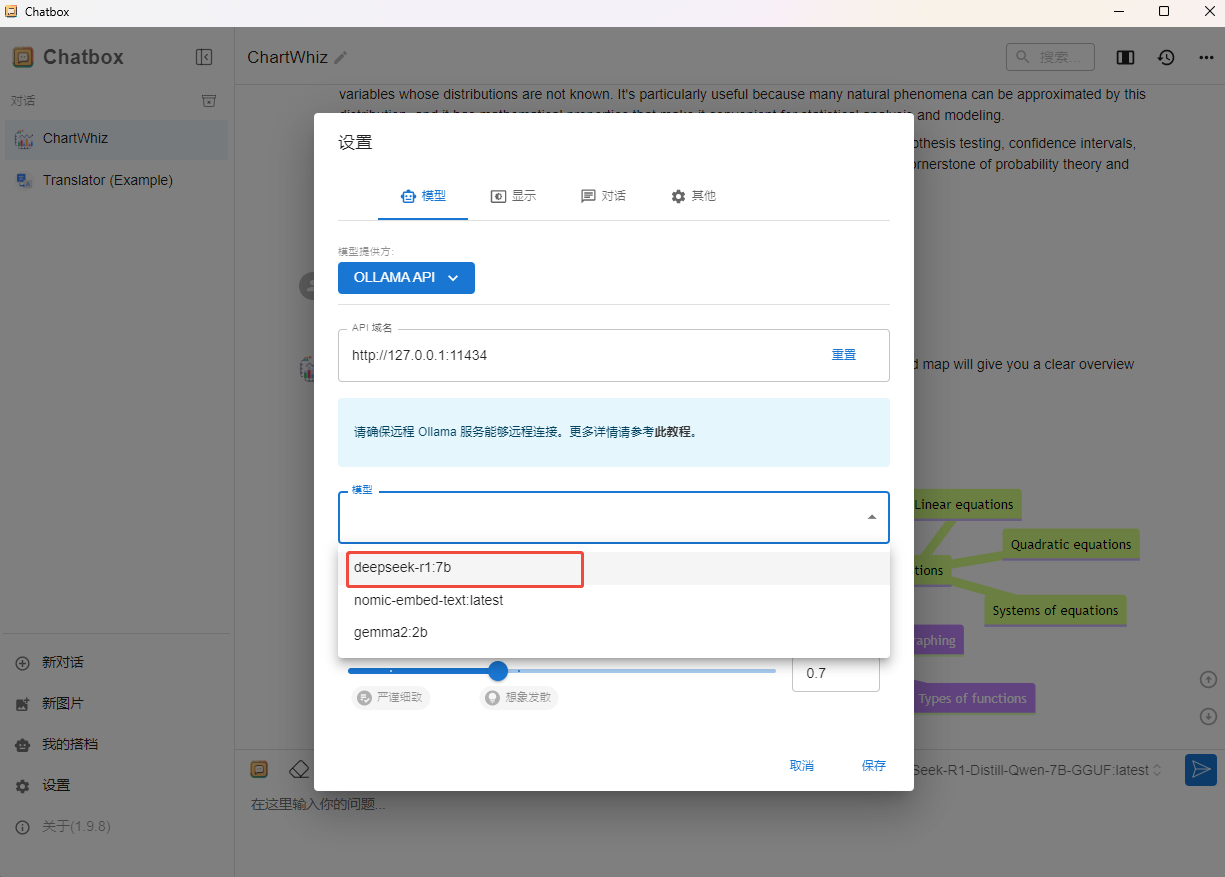

4.当然如果想要更为方便的 web ui 可以安装 chat box 工具(https://chatboxai.app)

在安装完成后设置内可以进行模型的选择